作者:余洋洋

编辑:张丽娟

一名游客将一家动物园告上了法庭,不为别的原因,就为该游客不满动物园新部署的人脸识别认证系统将被用来收集自己的个人数据。

这是国内第一次有人因为人脸识别所涉及到的安全隐私问题将一家商业机构告上法庭,也把这门自应用以来就颇具争议的技术再一次推上风口浪尖。

刷脸安检、支付、登机、乘坐地铁公交,乃至领结婚证、领养老金……人脸识别正在替代钥匙、公交卡、银行卡甚至身份证,快速渗透人们的衣食住行。

不管愿不愿意接受,我们正在快速进入一个“全民刷脸”的时代。随之而来的是,人们对人脸识别的焦虑和恐惧与日俱增。

首当其冲的是安全问题,刷脸支付是否能被轻易破解?

其次是众人皆知的隐私问题,也是这位将动物园告上法庭的游客最为担心的问题,动物园有没有权收集自己的人脸数据?而一旦动物园将自己的数据信息泄露出去怎么办?

更具争议的是,在教室、工地、办公室等场合,人脸识别乃至更多的尖端技术一度被用来“监控”广大学生和社畜。

这门技术引发种种问题让人们惶恐不安,科幻电影里的焦虑式想象更是将这种担忧加倍放大。

但有关人脸识别,到底有哪些问题值得警惕,又有哪些问题只是过度焦虑?CV智识就此采访多位AI公司人脸识别专家、算法工程师、人脸数据采集商、相关技术极客以及科学家,试图拨开迷雾与争议,尽可能客观地还原当下人脸识别技术最真实的商用状况。

你的脸安全吗?

一群小学生围着一个丰巢快递柜,其中一名小男孩用手里的打印照片对着快递柜一扫,就完成了人脸识别。

浙江一学校的一群小学生意外发现,只要用一张打印照片就能代替真人刷脸、骗过小区里的丰巢智能柜,取出父母们的货件。一张照片就能“蒙混过关”,人脸识别已经被一群小学生轻松破解。

对于刷脸支付安全性的质疑声随之而来。如果别人仅凭一张照片就能轻易解锁自己所有搭载人脸检测的设备,是不是别人就可以轻易盗取我的财物?

事实上,快递柜事件只是一个不具备典型性与代表性的极端个例。

“一张照片就能黑进系统,只能说这个自提柜系统就没有加活体识别技术,估计是产品经理觉得快递不值几个钱,贵重物品也不会放自提柜,就觉得没必要上这个功能了。”一位开发过人脸识别应用的算法工程师向CV智识解释。

但物品不贵重就不用活体识别技术了,莫非该产品经理瞧不起我们穷人?

当然不是。“毕竟活体识别技术研发成本不菲,而收集数据的成本一天就能达到几十万,”该工程师继续向CV智识解释。

云从科技某人脸识别应用开发者同样告诉CV智识,这件事情上其实就是人脸识别技术中的“活体检测技术”(判断是否真人,而非一张照片、视频或面具等)安全等级较低,需要在此项业务中加入高安全等级的活体检测技术。

现在的人脸识别从技术方案上分为2D和3D两种。典型的2D活体识别技术应用如支付宝,在人脸验证前,要你眨眨眼动一动,这就确保了完全静止的人脸,如照片,无法解锁。

3D则活体技术则意味着系统能获取验证者的深度信息,而3D活体技术安全到么程度呢?毫不夸张地说,其精准程度可以很轻松地辨认双胞胎或多胞胎。

现在,不管是知名大厂如阿里达摩院、腾讯AI Lab,AI公司如商汤、旷视、依图、云从,其提供的人脸识别服务都是基于3D活体技术,在重大考试、门禁安全系统中3D识别已经发挥出超乎想象的优势。替考、代考、瞒过安保?几乎不可能。

要想欺骗人脸脸识别到底有多难呢?

两位GeekPwn2019参赛选手、少年极客告诉CV智识,要想让AI把黄健翔识别成伊万卡,通过图像对抗的手段,他们勉强完成了这一挑战。“三个模型,我们只攻破了一个,并且攻破的效果不是特别好。它(AI)还是会反馈给你,它虽然认为图片是伊万卡,但给的信心很低。”

天才少年尚且难以做到100%攻破人脸识别,就不用说完全不懂技术的普通人,想要在终端攻破系统几乎不可能。

旷视科技某人脸识别应用开发人员告诉CV智识,“是否易被攻破。这不仅考验各家的算法实力,更重要的是抗攻击能力,如照片、视频、面具等.......相对而言,人脸识别是目前生物识别领域安全性较高的,当然它也并非万无一失,想要实现人脸识别安全、规模化落地需要技术水平、法律和法规和行业标准逐步完善。”

对于如何解决刷脸支付在安全上的隐患,云从科技某人脸识别应用开发者告诉CV智识,必须要格外注意到两个方面:第一即需刷脸+支付口令作为支付交易,避免单纯刷脸完成支付业务;第二即人脸信息和个人身份信息需分开保存,避免同时泄露的风险。

当然,安全是相对的,没有技术能保证100%的安全,目前普遍运用的3D活体人脸识别已经是安全程度较高,且攻破难度极大的加密手段了。

人脸识别会剥夺我们的隐私吗?

刷脸考勤,刷脸检票,刷脸支付,刷脸登录……无处不在的摄像头无时无刻不在捕捉着往来人们的年龄、种族、表情、身份、职业、收入、偏好、性格。而掌握背后摄像头的科技公司与相关机构们,则将我们的个人数据与隐私一览无余。

问题随之而来。人们开始担心一旦这些数据因保管不善而被泄露或是被黑客侵入,导致为不法分子利用可能产生的危害结果。

人脸识别技术强大的数据搜集与分析能力成了一把双刃剑,一方面它方便社会管理,另一方面也让人感到自己的个人隐私极大被冒犯。

对于数据的收集、使用问题,旷视科技某人脸识别应用开发人员告诉CV智识,“是否易获取。这包括获取业务现场的人脸数据和底库数据,仅拥有任何单一数据都无法完成识别比对。目前人脸识别商业应用场景中不管是数据采集、调用还是比对等任一环节都是需要在用户知情、并且同意的情况下才能进行。”

数据标注服务商Testin CTO陈冠诚同样告诉CV智识,他们所采集的数据必须是合法的。

“具体到数据采集标注我们有两方面,一块是安全性,一块是隐私性。安全性这块,我们所有的这些客户,可能几乎都会要求说这个数据只能给我,不能给其他家,所以我们这块会通过法律和法规,合约条款保证我们的数据,不管是整个数据处理的环节,还是说我最后数据的安全性都会保证合作伙伴的利益。”

“隐私性,大概牵扯到公民个人采集的数据,我们会要求个人授权。被采集的公民个体其实是授权我们使用这个数据。这个是我们从这个角度去保证的。”陈冠诚向CV智识解释,目前我们所接触到的商用人脸识别设备,不管是其用于训练的数据,还是采集的数据,都是通过合法正规渠道获得的。

而至于数据保管,多位人脸识别算法专家告诉CV智识,人脸生物样本的核心数据库是由公安、央行等核心机构掌握,并非一般商业运营商能够有权获得。

安装在校园、工作环境中的人脸识别设备,因为监控人们的行为甚至心理状态而引起了争议。人脸识别“一眼看穿”人们的个人隐私信息乃至心理状态确实令人们感到焦虑。

旷视科技将人脸识别设备搬进教室,用来分析学生上课的状态、表情、专注度的风波还没有完全结束。一波未平,一波又起。在美国,一家名叫Gaggle的公司则在用几乎一模一样的方法,监控学校里的学生。

随着问题受到关注,学校开始规范此类设备的应用。商业公司则开始反思,完善人脸识别应用中的隐私与道德问题。

云从科技某人脸识别应用开发者告诉CV智识,利用人脸识别类技术,无论是进行课堂管理还是教学效果分析,都不可避免要收集海量数据。对学生学习行为进行个性化追踪,而其目的在于经分析生成个性化的学习方案,以帮助学生提高学习效率,在这种理想情况下,是符合教育未来趋势的。

在该开发者看来,人脸识别作为一项技术,其本身并没什么问题,关键在于如何运用。同样的人脸识别技术,帮助幼儿园和小学建立智慧安防系统,用来寻找丢失的幼童或监护老人,就很少陷入争议。

“在教育场景内使用AI技术,需要进一步推进法治化进程,建立相关法律和法规,做到有法可依。这是确保技术不被滥用、限制技术的负面影响、真正发挥其促进教育教学作用的关键所在。”

随着人脸识别技术的应用引发广泛争议。为倡导善用AI,旷视在2019年7月推出了基于企业自身管理标准的《人工智能道德行为准则》,从正当性、人的监督、技术可靠性和安全性、公平和多样性、责任可追溯、数据隐私保护六个维度,对人工智能正确有序发展作出明确规范。

如何使用技术,不同的社会有不同的选择,但不变的共识则是技术从来应该被恰当地、正确地使用。

美国艺术与科学院院士、癌症免疫学家Carl June告诉CV智识,对于整个社会,包括科学家来讲,我们有责任去想一想这些新的技术到底应该怎么样去使用,现在技术发展非常迅速,但是不同的社会在接受和采纳新的技术上,积极性和意愿都会有所不同。

“作为科学家我的责任是保证癌症最终能获得治愈,我希望通过技术的进步能够实现这一目标,但是对于整个社会的挑战需要大家共同努力来应对。”Carl June同样认为,如何善用科技,应对技术滥用所带来的隐私与道德隐患,是全社会共同的责任,单凭科学家一己之力无法解决。

从疯狂到理性

经过几年密集、迅速的爆发式落地,人脸识别开始迈入理性发展阶段。安全、隐私、道德,不加区别的过度应用所导致的问题如潮水般涌来,反思也随之而来。

随着“中国人脸识别第一案”立案,人们开始拿起法律武器应对人脸识别过度应用带给他们的种种担忧。不管是学校还是动物园,更多此前使用人脸识别应用的机构开始考虑到应用新技术在带给他们管理便利的同时,可能产生的副作用。

旷视、云从等提供人脸识别服务的公司,则在反复斟酌技术的安全性,并且制定相关道德准则规范自己。技术与商业天才们在思考怎样赢得市场之间的竞争,怎样实现利益最大化,怎样交出一份好看的财务报表的同时,开始考虑到用户作为人的安全,隐私与尊严。

综合对多位行业内人士的采访, CV智识发现,对于大众担忧的安全和数据隐私问题,业内已经有了一套相对成熟的解决方案。至于用人脸识别来“监视”广大学生和社畜,以掌握学生学习和工人工作状况,则是目前争议最大的一个领域。

新技术带来的问题不容忽视,而不明真相带来的过度焦虑也有必要缓一缓。

产业合作推动AI发展 高通孟樸:携手伙伴共抓5G+AI新机遇

产业合作推动AI发展 高通孟樸:携手伙伴共抓5G+AI新机遇 西门子2024 Realize LIVE用户大会:拥抱新质生产力,激发数智新动能

西门子2024 Realize LIVE用户大会:拥抱新质生产力,激发数智新动能 AI技术赋能内容生产全链路 芒果探索“文化+科技”的下一步

AI技术赋能内容生产全链路 芒果探索“文化+科技”的下一步 全国人大代表刘宏志:推动数字乡村建设、激发乡村振兴“数智力量”

全国人大代表刘宏志:推动数字乡村建设、激发乡村振兴“数智力量” 情人节不止214 DR钻戒将七夕情人节传至海外

情人节不止214 DR钻戒将七夕情人节传至海外 “E动新生 旗心共创” “航价比之王”红旗E-QM5专场团购会火热爆单

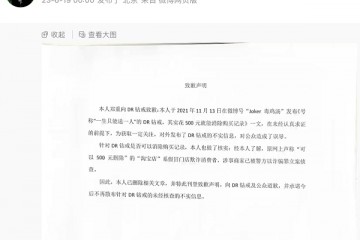

“E动新生 旗心共创” “航价比之王”红旗E-QM5专场团购会火热爆单 “DR购买记录可删”被证实是谣言,传谣者公开道歉

“DR购买记录可删”被证实是谣言,传谣者公开道歉 红旗新能源最新宠粉,E001首批盲订车主踏上“溯源之旅”

红旗新能源最新宠粉,E001首批盲订车主踏上“溯源之旅” 5月销量成绩瞩目 新能源战略引领红旗品牌再向上

5月销量成绩瞩目 新能源战略引领红旗品牌再向上 高通总法律顾问卓安琳:持续创新开放合作,助力中国伙伴在5G时代取得更

高通总法律顾问卓安琳:持续创新开放合作,助力中国伙伴在5G时代取得更